[Github]

[arXiv](2024/01/24 version v1)

Abstract

큰 모델, 대규모 데이터, MLLM (Multimodal-LLM)의 이해력을 활용한 이미지 복원 방법인 SUPIR 소개

Introduction

역대 최대 규모(자칭)의 IR(Image Restoration) 방법인 SUPIR (Scaling-UP IR) 소개.

SDXL에서 6억 개가 넘는 피라미터를 가진 어댑터를 설계하고 훈련한다. 또한 2천만 개가 넘는 고해상도 이미지, 13B의 MLLM 활용.

Method

- Model Scaling Up

- Scaling Up Training Data

- Restoration-Guided Sampling

Model Scaling Up

Generative Prior

SDXL의 base model 사용.

Degradation-Robust Encoder

SDXL의 인코더는 Low-Quality 이미지에 대해 훈련되지 않았기 때문에 LQ 이미지의 아티팩트를 content로 오해할 수 있다. 따라서 다음의 손실을 최소화:

Large-Scale Adaptor Design

LoRA, T2I-adapter, ControlNet 중 어느 것도 LQ 이미지 제어에 효과적이지 않았기 때문에 새로운 어댑터 설계.

- ControlNet의 Encoder block의 ViT block 절반을 trimming. (b)

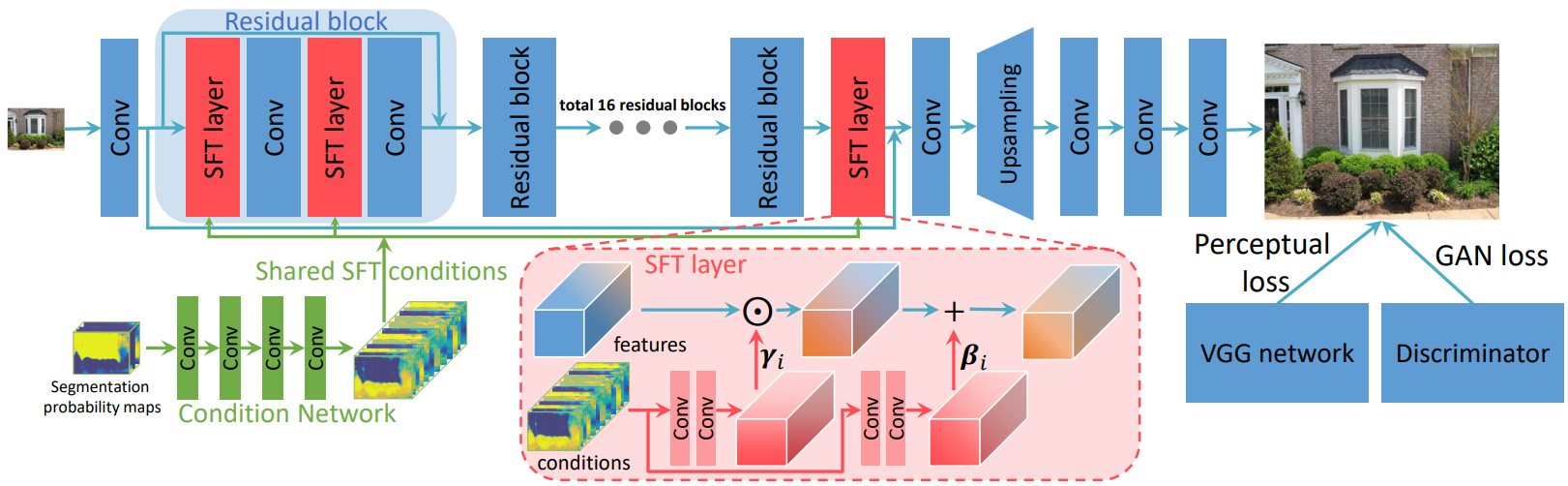

- ControlNet의 잔차 만으로 픽셀 수준의 정밀한 제어는 불가능하기 때문에 spatial feature transfer (SFT)를 포함하는 ZeroSFT Connector 도입. (c)

Scaling Up Training Data

Image Collection

2천만 개의 고해상도 이미지 데이터 수집.

Multi-Modality Language Guidance

IR에서는 이미지의 내용을 이해하는 것이 중요하기 때문에 LLaVA를 통해 guide prompt를 출력한다.

또한 PixArt의 접근 방식에 따라 모든 훈련 이미지에 대한 text annotation을 수집하여 prompt를 기반으로 이미지를 복원하는 기능을 부여한다.

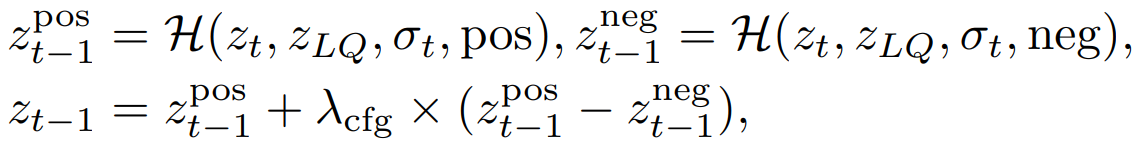

Negative-Quality Samples and Prompt

CFG에는 negative prompt를 사용하여 저품질 이미지를 생성하지 않도록 하는 기능이 있다.

하지만 SUPIR이 negative prompt(“oil painting, cartoon, blur, dirty, messy, low quality, deformation, low resolution, oversmooth”)를 이해하지 못할 수 있기 때문에 SDXL을 사용하여 해당 prompt의 100K 이미지를 생성하고 훈련 데이터에 추가한다.

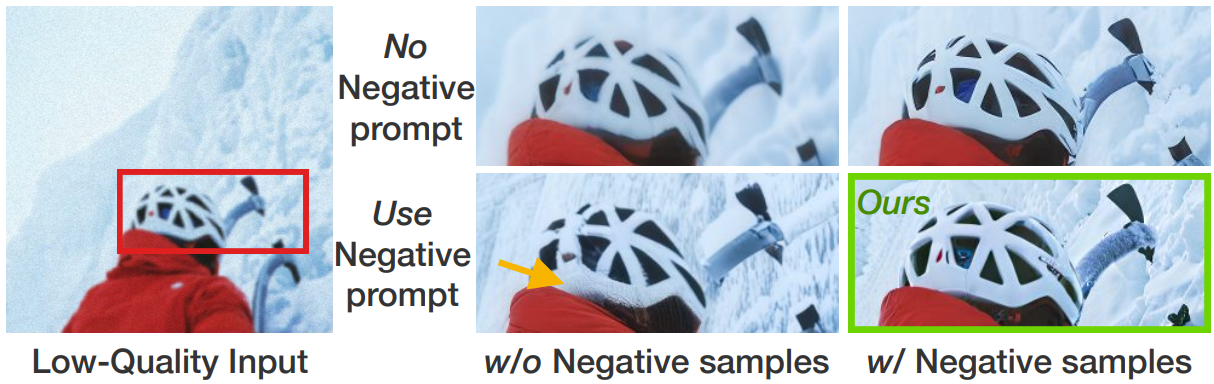

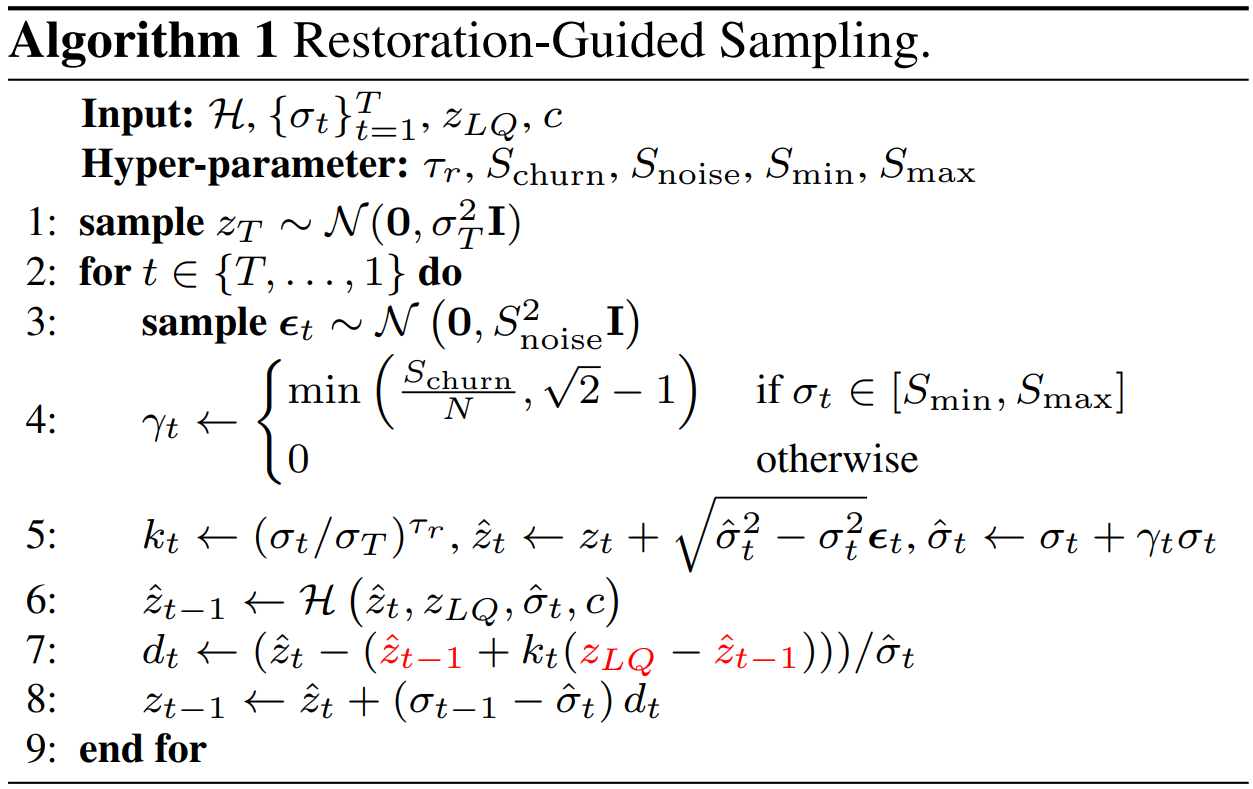

Restoration-Guided Sampling

SDXL의 큰 generation capacity가 부정적인 영향을 끼칠 수 있다. 이는 IR 작업의 근본적인 차이점으로, 생성된 이미지는 LQ 이미지에 충실해야 한다.

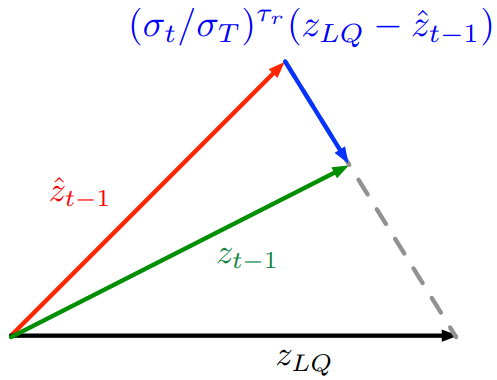

EDM sampling을 수정하여 각 timestep에서 zt-1이 zLQ에 가까워지도록 유도한다.

IR과 관련 있는 하이퍼 피라미터는 τr 뿐이다.

Weight term은 저주파 정보가 주로 생성되는 초기 process에서 크고 t가 0에 가까워질수록 영향을 미치지 않는다.

Experiments

SUPIR - XPixel Group

SUPIR Intelligent Image Resotoration Large Model.

supir.xpixel.group