disentangled LoRA

[Github]

[arXiv](Current version v2)

Abstract

다른 속성과의 간섭을 최소화하면서 하나의 개념에 해당하는 low-rank 피라미터 방향을 식별하고 정밀하게 제어할 수 있는 concept slider를 제시한다.

Introduction

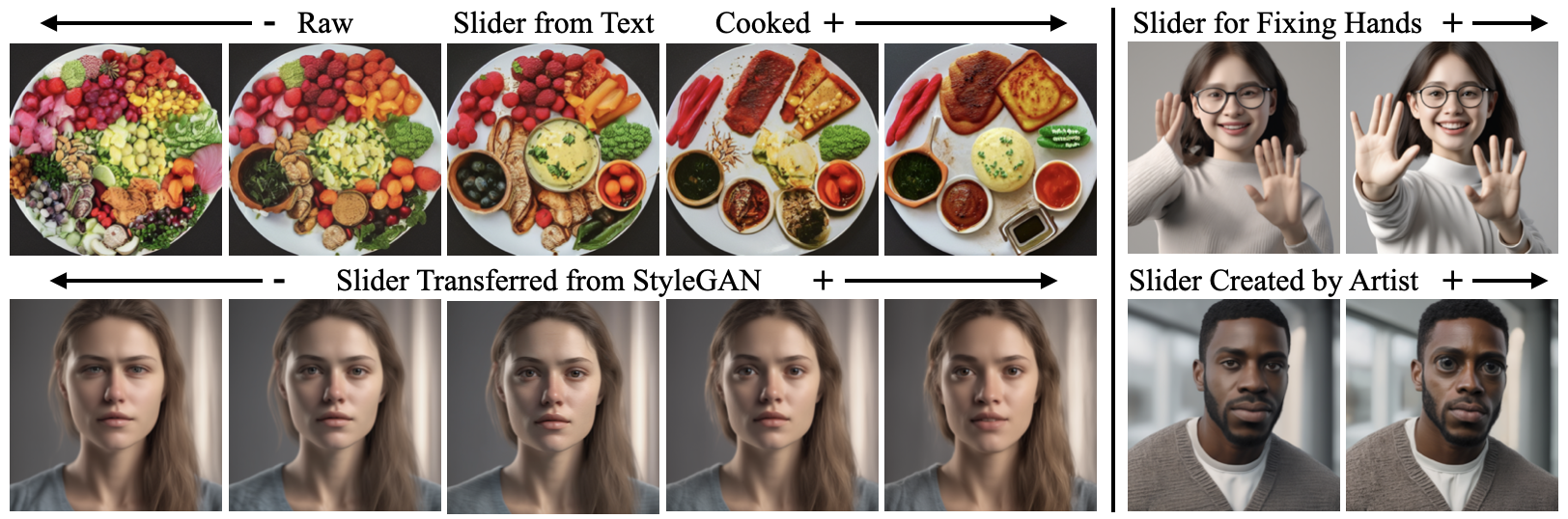

Concept slider는 low-rank 수정을 통해 효율적인 구성과 최소한의 얽힘으로 개념에 대한 정밀하고 지속적인 제어를 가능하게 하는 adaptor를 제공한다.

이미지 쌍을 통해 텍스트보다 더 복잡한 편집이 가능하고 모듈식으로 수십 개의 슬라이더를 구성할 수도 있다.

Background

Method

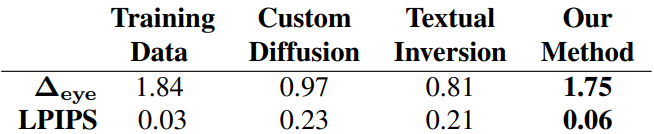

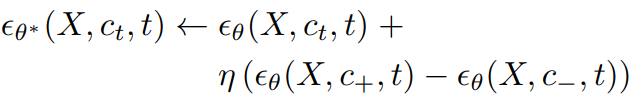

대상 개념 ct(text), 모델 θ 주어지면 우리의 목표는 image X에서 c+와 c-의 likeihood를 수정하는 θ*를 얻는 것이다.

∇log Pθ∗(X|ct)는 다음에 비례한다:

Reparametrization trick을 통해 denoising prediction으로 표현할 수 있다.

보존 개념 p 도입(e.g. 성별을 바꾸는 동안 인종이 바뀌면 안 됨).

보존 개념에 대한 여러 쌍의 프롬프트를 통해 disentanglement가 향상됨.

위 목표를 통해 concept slider를 훈련한다.

추론 시 LoRA scaling factor α를 통해 편집 강도를 조절할 수 있다.

Learning Visual Concepts from Image Pairs

텍스트로 지정하기 어려운 시각적 개념에 대해서는 전/후 이미지 쌍을 통해 훈련.

After image : 임의의 lora scale에서 xtB → xB 예측

Before image :임의의 -lora scale에서 xtA → xA 예측

(텍스트 훈련에서는 lora scale α = 1)

Experiments

추론 시 임의의 timestep까지 원래 모델을 사용하는 SDEdit 사용.