이미지 태깅을 위한 foundation model

Abstract

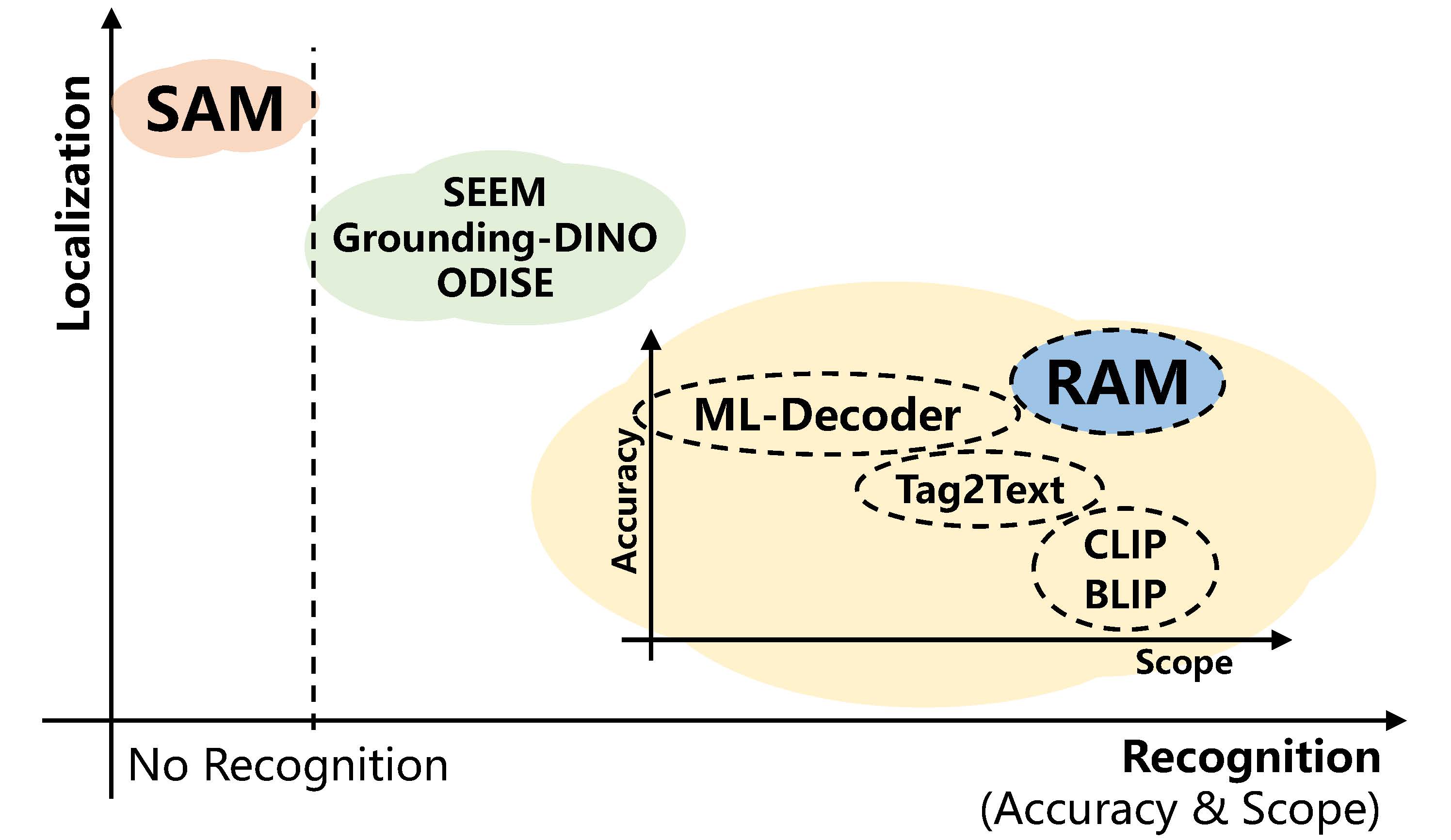

이미지 태깅을 위한 강력한 foundation model인 RAM(Recognize Anything Model) 제안

Introduction

- Label System : 보편적이고 통합된 label system 구축

- Dataset : Label system으로 대규모 이미지에 자동으로 주석 추가

- Data Engine : 모델을 활용하여 주성을 생성, 필터링하는 데이터 엔진 구축

- Model : Tag2Text와 달리 zero-shot 일반화 가능

훈련 과정

- 대규모 데이터셋에서 pretrain

- RAM 훈련

- 데이터 엔진을 통해 데이터셋 보강, 필터링

- RAM fine-tuning

RAM의 장점

- 강력한 zero-shot 일반화, 태깅 능력

- 고품질 데이터를 직접 수집하지 않아도 됨

- 가벼움

- 유연함

Recognize Anything Model

Model Architecture

Tag2Text와 유사한 아키텍처.

Text Semantic Parser를 통해 수동 주석 없이 대규모 태그 제공.

Tag2Text와의 주요 차이점은 훈련 중에 보지 못한 카테고리를 인식할 수 있다는 것.

Open-Vocabulary Recognition

일반화를 위해 기성 텍스트 인코더로 recognition decoder에 query 제공.

Model Efficiency

대규모 데이터에서 pretrain 후 소규모 고품질 데이터에서 fine-tuning

추론 단계에서는 recognition decoder의 self attention 계층을 제거하여 계산 효율성을 높이고 label query 간의 잠재적 간섭을 피함.

결과적으로 고정된 카테고리 및 수량 대신 사용자가 지정한 모든 카테고리 및 수량에 대한 label query 활용 가능.

Data

Label System

Label system의 기본 원칙

- Image-text 쌍에 자주 나타나는 태그일수록 더 가치있다.

- scene, attribute, action 등 다양한 context가 표현되어야 한다.

- 너무 많지 않은 적당한 양의 태그

SceneGraphParser와 약간의 수작업으로 태그를 수집, 필터링하여 label system 구축.

RAM은 약 6000개의 고정 태그를 인식 가능.

Datasets

대규모 오픈소스 데이터셋에서 RAM 사전 훈련.

Data Engine

Pretrained RAM으로 데이터 보완.

RAM, Grounding DINO, K-Means++ 등의 모델을 통해 이상치 필터링

Experiment

'논문 리뷰 > Vision Transformer' 카테고리의 다른 글

| StyleDrop: Text-to-Image Generation in Any Style (1) | 2023.09.26 |

|---|---|

| Fast Segment Anything (FastSAM) (1) | 2023.07.14 |

| Self-Supervised Learning from Images with a Joint-Embedding Predictive Architecture (I-JEPA) (0) | 2023.07.08 |

| Tag2Text: Guiding Vision-Language Model via Image Tagging (0) | 2023.06.19 |

| Grounding DINO: Marrying DINO with Grounded Pre-Training for Open-Set Object Detection (0) | 2023.06.19 |

| Matting Anything (MAM) (0) | 2023.06.15 |